i5-10400 集显台式机3步部署本地离线AI大模型(Ollama)

之前搞黑苹果配的台式机一直没有配显卡以为没办法搞本地大模型,没想到现在只要内存够大已经可以用Ollama来部署本地大模型了。在之前遇到过一个小插曲,因为网上有看到《Ollama 英特尔优化版》的教程,根据上面的教程一直跑不起来,后来就直接使用Ollama官方的版本来使用了。

win11系统电脑配置:

1、intel i5-10400

2、16G*2 双通道内存32G

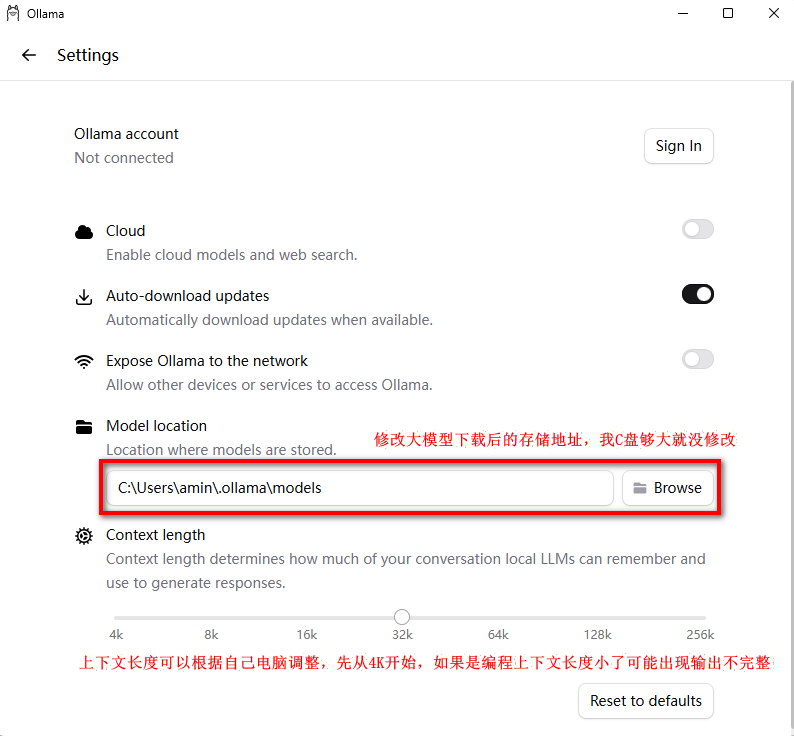

3、2T机械硬盘(建议C盘有较大的空闲空间)一、下载安装Ollama

直接访问Ollama官网下载 https://ollama.com/download (github下载地址:https://github.com/ollama/ollama/releases/)

安装过程忽略,打开后可以配置下大模型存储路径(Ollama程序 – Settings)

二、下载大模型

在windows开始菜单搜索“命令提示符”,输入ollama pull deepseek-r1:1.5b进行下载即可

上面下载完就可以直接到第三步在Ollama中与本地大模型进行对话了。

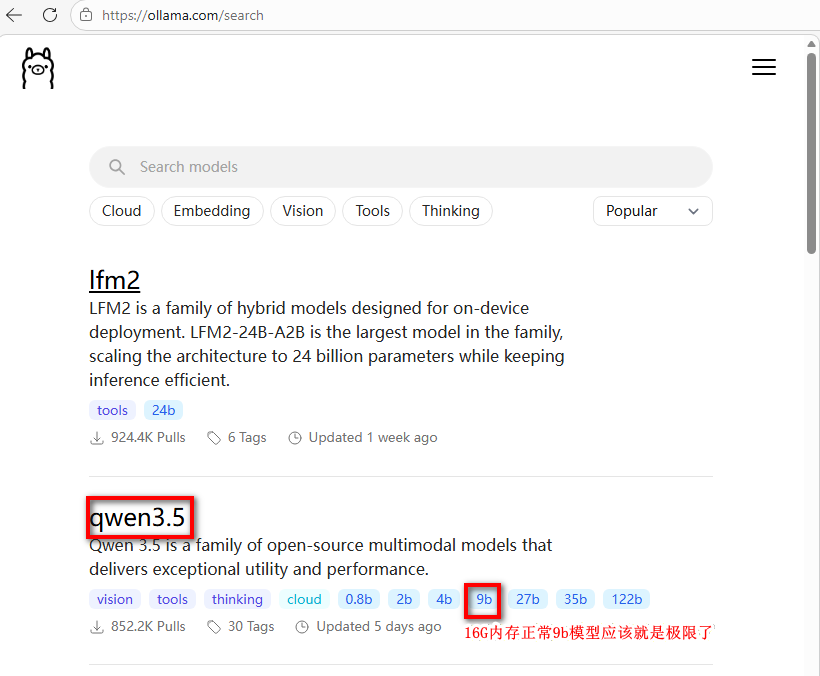

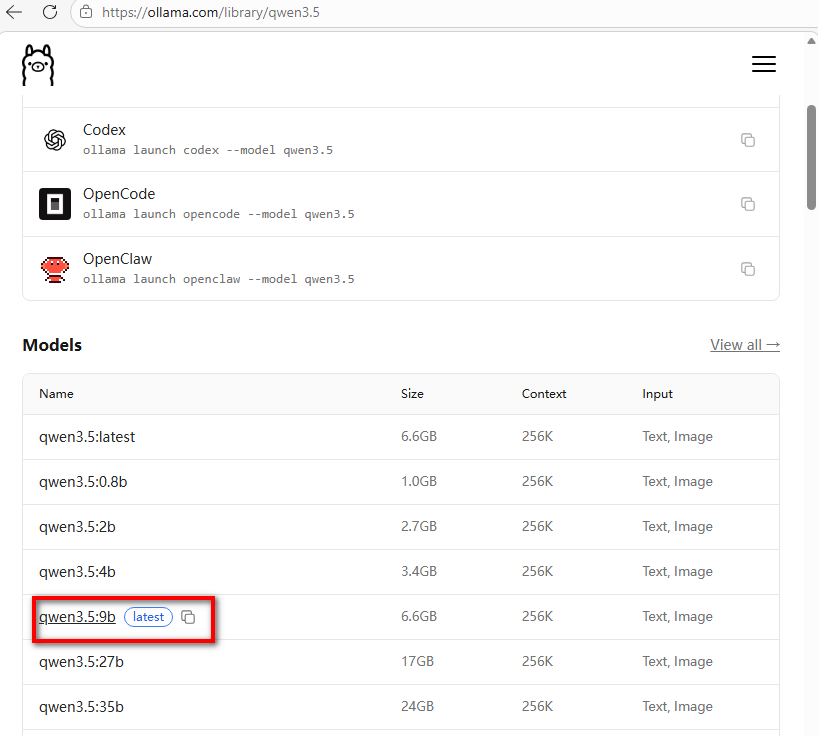

PS:如果想要下载其他大模型(上面指令是下载DeepSeek r1的1.5b版本,1.5b也就是15亿参数量,这个b越大模型需要的显存/内存就越大,模型也越智能),可以在Ollama官网查看并下载 https://ollama.com/search

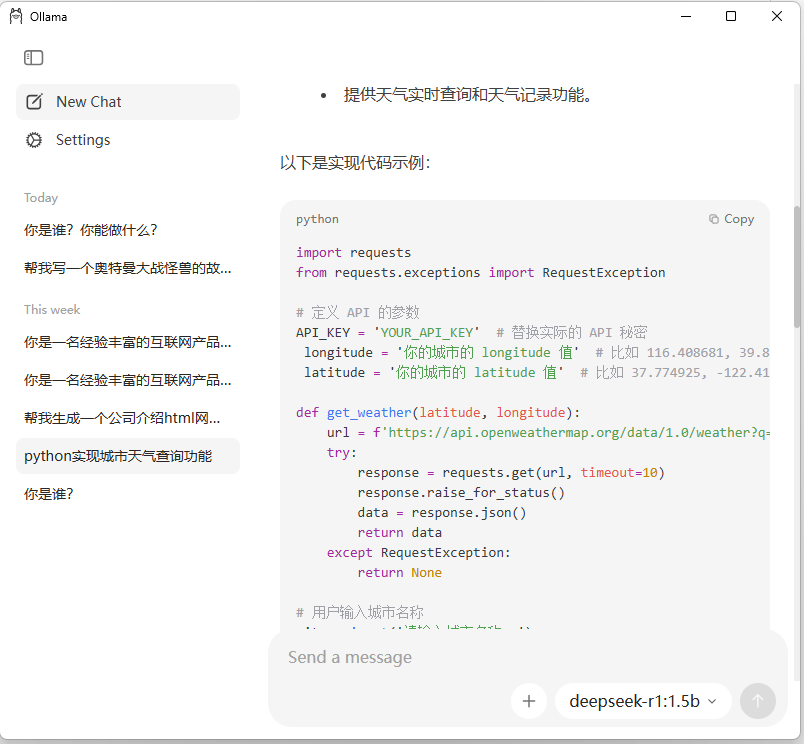

三、开始与本地大模型聊天聊天

现在在Ollama程序里面直接就可以选择大模型聊天了(如果直接选择一个尚未下载的大模型直接对话,会在对话前会进行下载,但是好像下载并不稳定,还是建议在命令提示符里单独下载)。

事实证明内存+CPU跑大模型还是比较勉强的,8b模型吐字很慢了,1.5b还是比较快的,一张8G显存的独显估计也能吊打我了。本地模型不用担心数据泄露问题,轻度体验没问题,用来生产还是需要一定的硬件实力。另外就是模型下载,部分模型已经做了“合规”有的内容会直接拒绝回答,可以多尝试一些模型体验对比下。也可以下载别人定向微调过的小模型,比如微调后专门用于编程领域的8b模型,可能性能跟100b的通用模型在编程方面的能力差不多。

四、参考

1、Ollama入门指南 https://juejin.cn/post/7611832090888208424

2、离线部署大模型:Ollama+DeepSeek+Openwebui安装使用方法及常见问题解决 https://juejin.cn/post/7503884161514520591

3、Ollama 英特尔优化版 https://www.modelscope.cn/models/intel/ollama/summary

发表评论